밑바닥부터 Kanana LLM 개발하기: Pre-training

LLMKanana LLMPre-training언어모델Two staged pre-training데이터학습 전략

AI 요약

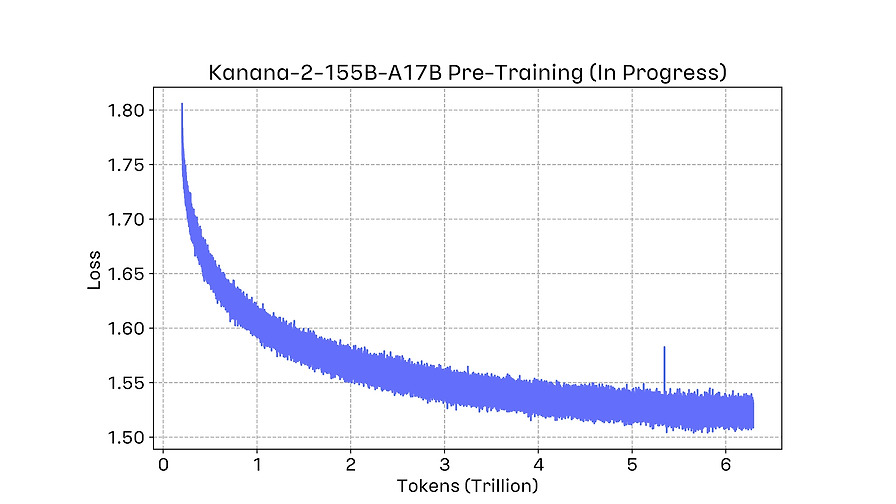

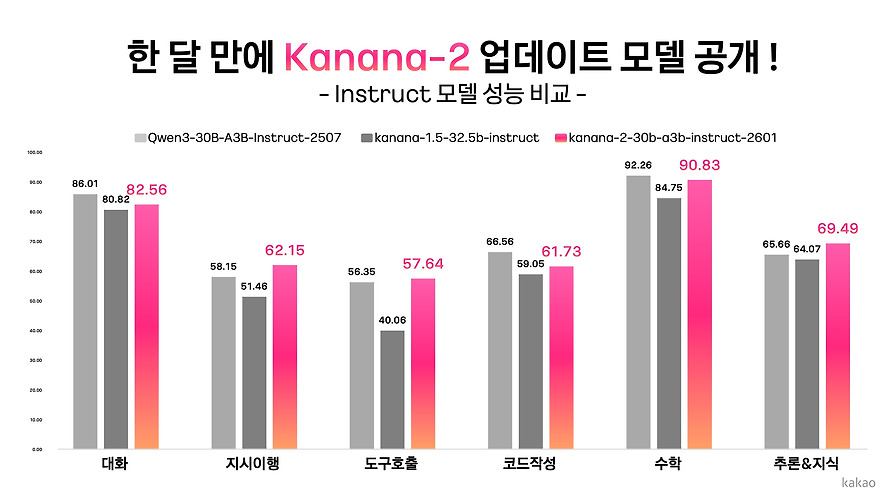

Beta카카오의 AI 모델 개발 조직인 카나나 알파에서 자체 개발한 Kanana LLM(Kanana Nano, Essence, Flag)의 Pre-training 과정과 성능 결과를 소개하는 글입니다. 특히 Kanana Essence와 Nano 모델은 서비스 최적화 중형 모델과 모바일 초경량 모델로, 유사 사이즈 글로벌 SOTA 모델 대비 동등한 영어 성능과 뛰어난 한국어 성능을 달성했습니다.

LLM 학습은 Pre-training과 Post-training으로 나뉘며, 막대한 컴퓨팅 자원이 필요한 Pre-training의 효율성을 높이기 위해 'Two staged pre-training' 전략을 채택했습니다. 이 전략은 Pre-training을 Stable stage와 Decay stage로 나누어 서로 다른 데이터 분포를 활용하는 방식으로, 기존 Scaling law의 한계를 극복하고 적은 자원으로도 고성능 LLM을 개발하는 데 중점을 둡니다.

글에서는 이 학습 과정과 데이터, 전략에 대해 상세히 다룹니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기