모델 크기 경쟁을 넘어: MoE가 제시하는 스마트한 AI

LLMMoEMixture of ExpertsAI 아키텍처모델 효율성대규모 언어 모델

AI 요약

Beta본 글은 대규모 언어 모델(LLM) 분야에서 모델 크기 경쟁의 한계를 지적하며, 효율성과 성능을 동시에 잡을 수 있는 MoE(Mixture of Experts) 아키텍처를 소개합니다. MoE는 거대한 단일 신경망 대신, 여러 전문 '전문가' 네트워크를 활용하여 입력에 따라 필요한 전문가만 선택적으로 사용하는 구조입니다.

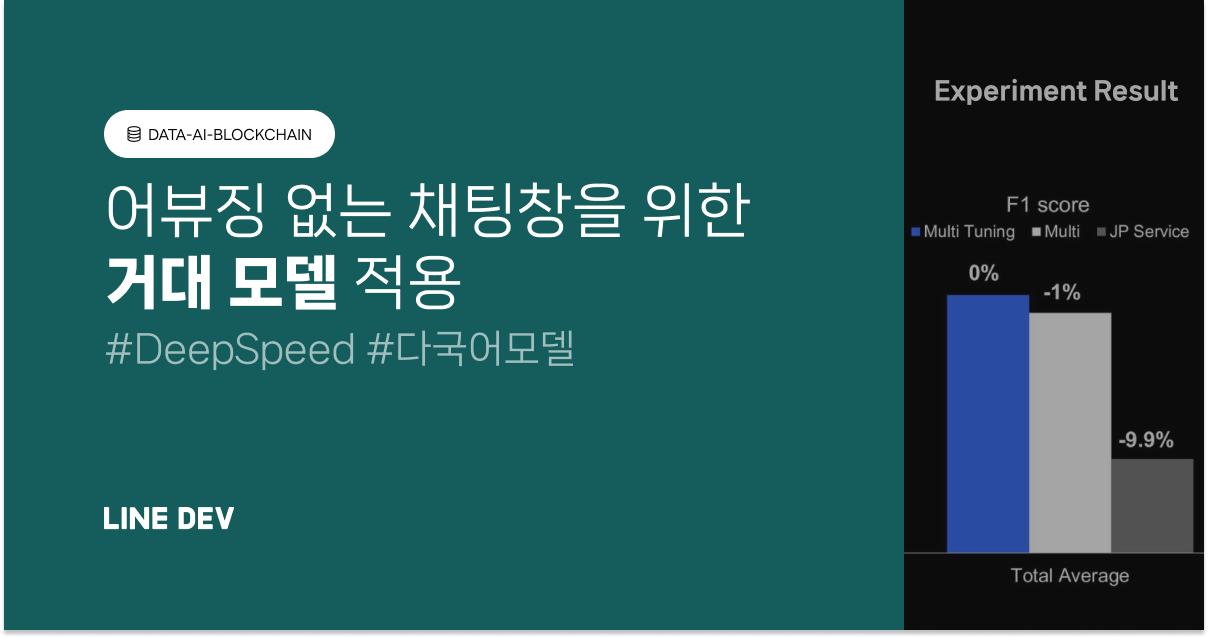

이를 통해 전체적으로는 큰 모델이지만 실제 추론 시에는 계산량을 줄여 효율성을 높이고, 생성되는 문장의 질은 유지할 수 있습니다. GPT-4, Qwen3 등 최신 LLM들이 MoE를 채택하고 있으며, 이는 모델 크기 증가에 따른 창발 효과의 한계 체감과 기하급수적인 계산 비용 및 에너지 소비 증가 문제를 해결하는 대안으로 주목받고 있습니다.

AI 내부 구조에 관심 있는 개발자들에게 MoE의 개념과 필요성을 설명하며, 지속 가능한 AI 발전을 위한 스마트한 접근법을 제시합니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기