Noisy Gradient 다루기

딥러닝Noisy GradientSGDVarianceTransformerNLP

AI 요약

Beta이 글은 딥러닝 학습 시 발생하는 'Noisy Gradient Problem'에 대해 다룹니다. Noisy Gradient는 Stochastic Gradient Descent(SGD)에서 미니배치로 계산된 Gradient의 오차(Variance)가 커서 학습이 불안정해지는 현상을 의미합니다.

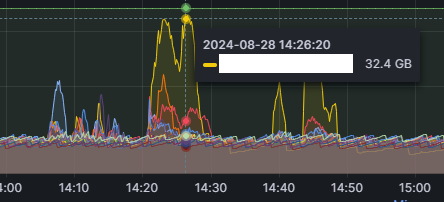

이러한 문제는 Loss Surface에서 최적점으로 수렴하는 데 어려움을 초래하며, 실제 NLP 분야의 Transformer 모델에서도 학습 초기의 불안정성을 해결하기 위해 Warmup 기법을 사용하는 사례가 있습니다. 글에서는 Noisy Gradient Problem의 개념을 설명하고, 이로 인해 발생하는 학습의 어려움을 시각적인 자료와 함께 제시하며, 마키나락스에서 겪었던 실제 사례를 통해 문제 해결 방안을 모색할 것임을 예고합니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기