Amazon EKS에서vLLM Deep Learning Container를 사용하여LLM 배포하기

LLMvLLMAmazon EKSDeep Learning ContainerAWSGPU배포

AI 요약

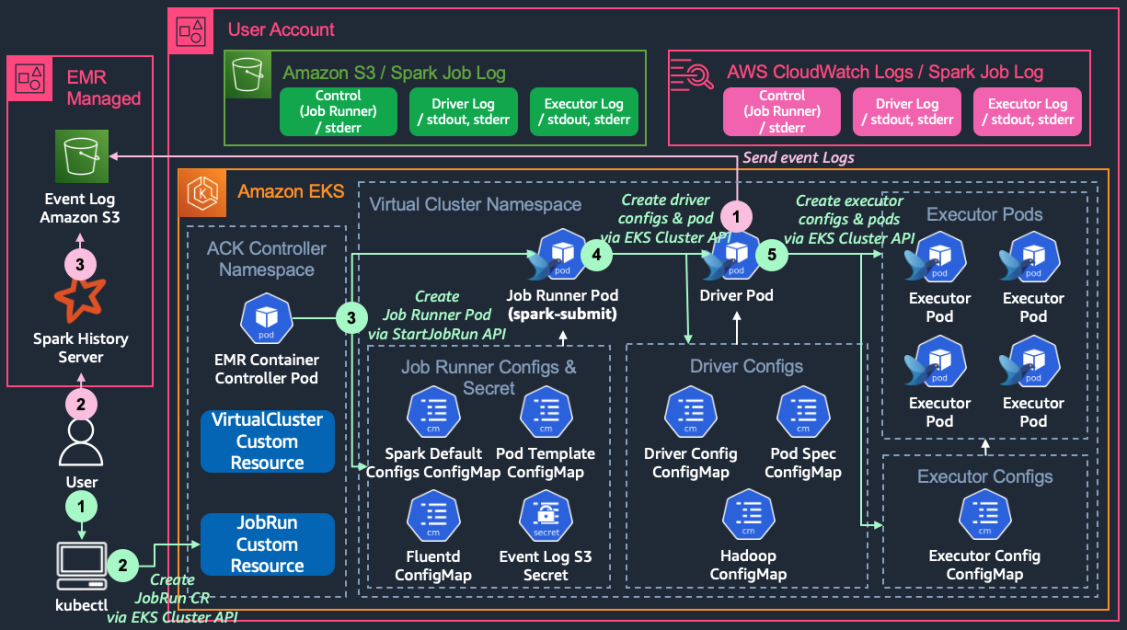

Beta이 글은 AWS Architecture Blog의 "Deploy LLMs on Amazon EKS using vLLM Deep Learning Containers"를 번역 및 편집한 내용입니다. 대규모 언어 모델(LLM)을 Amazon EKS(Elastic Kubernetes Service)에 효율적으로 배포하는 방법을 다룹니다.

LLM 배포 시 GPU 리소스 활용 최적화, 네트워크 인프라 관리, 모델 가중치 접근성 확보 등의 어려움이 존재합니다. vLLM Deep Learning Container를 사용하면 이러한 과제를 해결하고 분산 추론 워크로드를 효과적으로 관리할 수 있습니다.

글에서는 EKS 환경에서 vLLM을 활용하여 LLM을 배포하는 구체적인 기술적 접근 방안을 제시하며, GPU 집약적인 AI 모델의 효율적인 운영을 위한 AWS 기반 솔루션을 소개합니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기