Amazon Bedrock과 OpenSearch를 활용한 Multimodal RAG 기반 상품 검색 챗봇

Multimodal RAGLLMMultimodal EmbeddingAmazon Bedrock AgentsOpenSearch상품 검색 챗봇

AI 요약

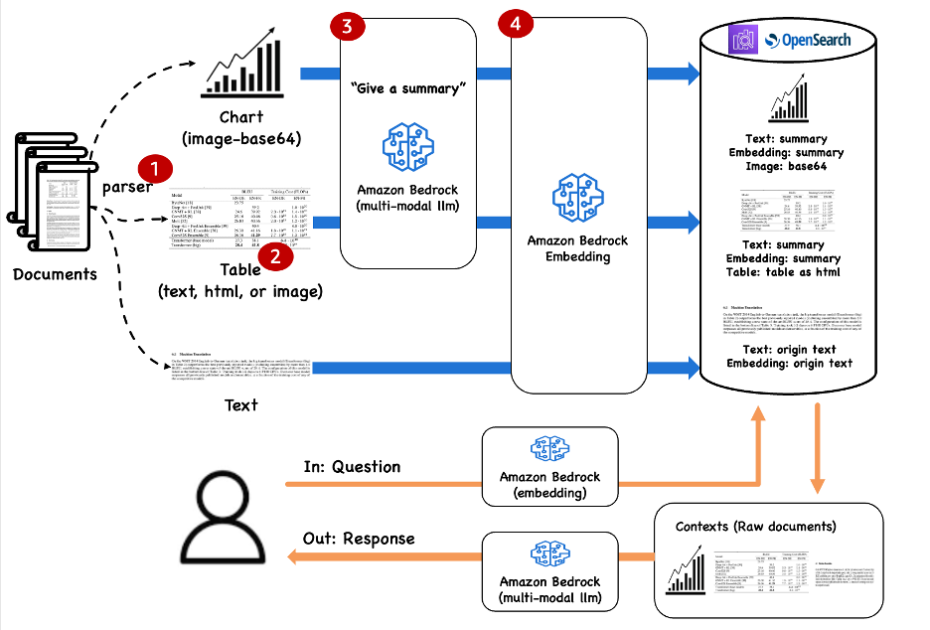

Beta이 글은 Amazon Bedrock과 OpenSearch를 활용하여 Multimodal RAG 기반의 상품 검색 챗봇을 구현하는 방안을 제시합니다. Multimodal LLM과 Multimodal Embedding 기술을 사용하여 텍스트뿐만 아니라 이미지까지 처리 가능한 RAG 시스템을 구축하는 방법을 설명합니다.

특히, 서로 다른 모달리티(텍스트, 이미지)를 동일한 벡터 공간에 표현하는 Multimodal Embedding의 개념과 이를 통해 데이터 간의 유사성을 계산하는 과정을 소개합니다. 이를 통해 사용자의 텍스트 또는 이미지 요청에 대해 관련 상품 정보를 정확하게 검색하고, LLM이 환각 현상 없이 신뢰성 있는 답변을 생성하도록 돕는 챗봇 구현 가능성을 보여줍니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기