AITER 분석: AMD가 ROCm inference 성능을 2배로 올린 방법

AMDROCmAITERInferenceGPU커널 최적화LLM

AI 요약

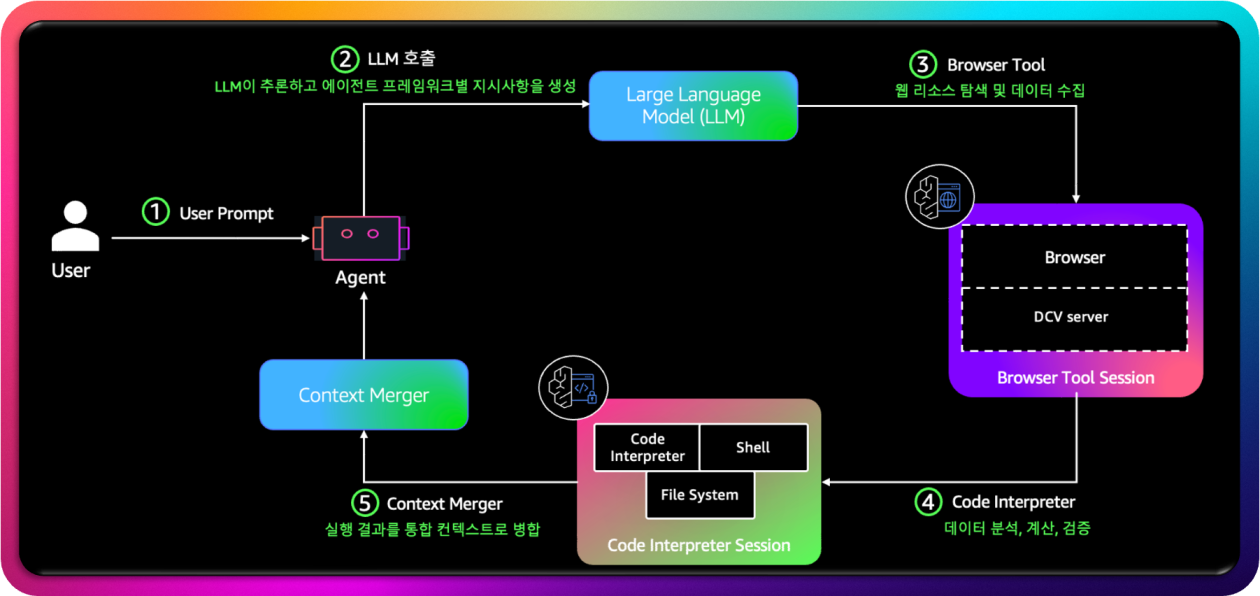

BetaAMD가 ROCm inference 성능을 2배 향상시킨 AITER 커널 라이브러리를 분석합니다. AITER는 AMD GPU에서 AI 워크로드를 가속하기 위한 고성능 연산자 통합 저장소로, NVIDIA의 cuDNN과 유사한 역할을 합니다.

이 글은 AITER의 아키텍처, 4가지 커널 백엔드 전략(Triton, CK, HIP, ASM), JIT 컴파일 파이프라인, 그리고 DeepSeek R1에서 2배의 처리량 향상을 달성한 구조를 상세히 설명합니다. 특히, 드롭인 교체 방식으로 vLLM, SGLang과 같은 추론 프레임워크에서 쉽게 적용되어 성능을 개선할 수 있음을 강조합니다.

AMD GPU의 추론 성능 현황, GPU 커널 최적화 기법, 그리고 NVIDIA 외 AI 가속기 생태계에 관심 있는 독자들에게 유용한 정보를 제공합니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기