BERT를 활용한 챗봇 시스템

BERTNLP딥러닝Transformer임베딩GLUESQUAD

AI 요약

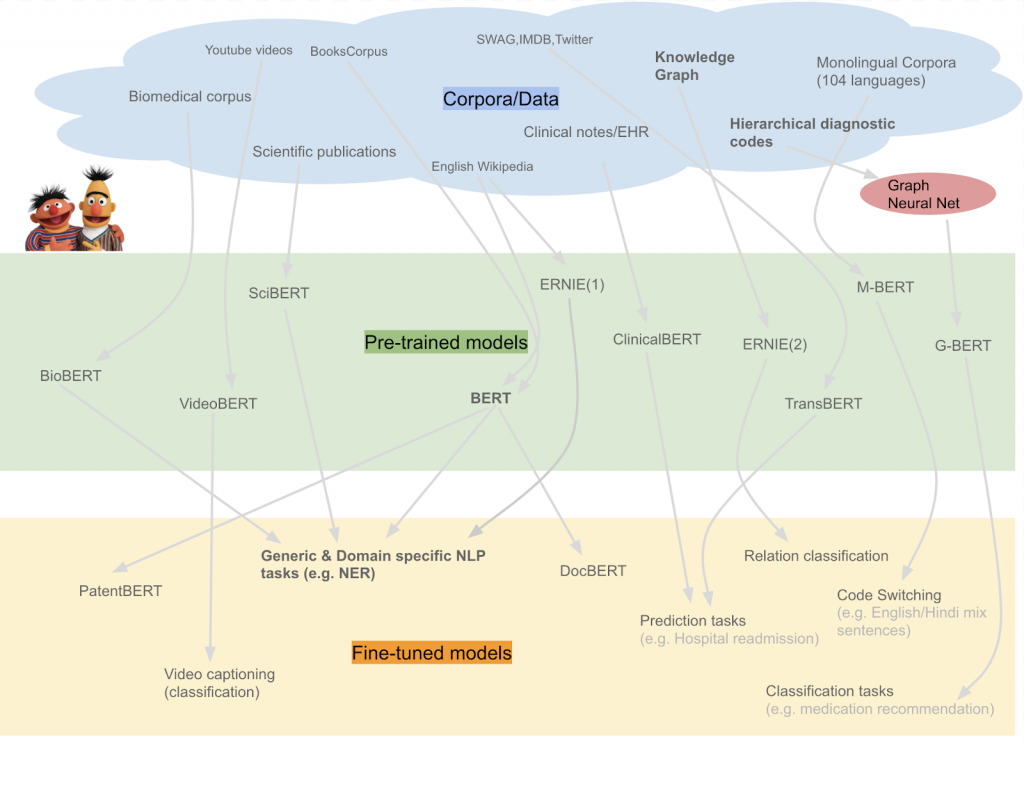

Beta이 글은 딥러닝 분야에서 NLP의 'ImageNet Moment'를 열었다고 평가받는 BERT 모델에 대해 설명합니다. BERT는 2018년 Google에서 공개한 모델로, Transformer 아키텍처를 기반으로 문맥을 이해하는 임베딩을 생성합니다.

Masked Language Model 방식으로 사전 학습되어 다양한 NLP 태스크에서 뛰어난 성능을 보이며, GLUE 및 SQUAD 벤치마크에서 기존 최고 성능을 경신했습니다. BERT의 등장 이후 많은 NLP 연구와 서비스에 BERT 또는 이를 개선한 모델들이 활용되기 시작했으며, 이는 인공지능 기술의 발전에 큰 영향을 미쳤습니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기