효율적인 모델 추론 서비스를 위한 Nvidia Triton 아키텍처 소개 및 Quick Start

Nvidia Triton모델 추론TensorRTAI 서빙머신러닝배포

AI 요약

Beta이 글은 Nvidia Triton Inference Server(TRTIS)를 소개하며, TensorRT 엔진을 사용한 추론 작업의 복잡성을 해결하고 효율성을 높이는 방법을 설명합니다. TRTIS는 Python이나 C++로 직접 추론 코드를 작성하는 것보다 접근이 용이하며, 클라이언트 코드 재작성 없이 서버 방식으로 배포 가능합니다.

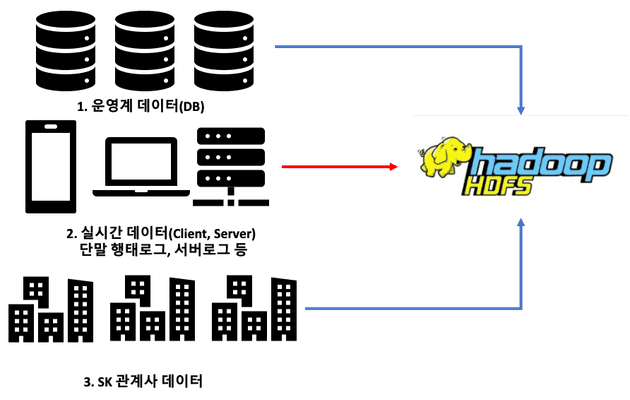

또한, Multi GPU Inference를 자동으로 지원하고 모델 버전 관리 및 배포를 용이하게 하여 개발 시간을 단축시킵니다. AI 모델은 훈련 후 프로덕션 단계에서 추론 서빙을 수행하는데, 이는 다양한 프레임워크, 쿼리 유형, 모델 진화, 하드웨어 환경 등 복잡성을 가집니다.

TRTIS는 이러한 복잡성을 해결하고 고성능 모델 추론 서비스를 구축하는 데 도움을 주는 솔루션입니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기