Amazon SageMaker로 LLM 응답 Streaming 서빙하기

SageMakerLLMStreamingLambdaCloudFront

AI 요약

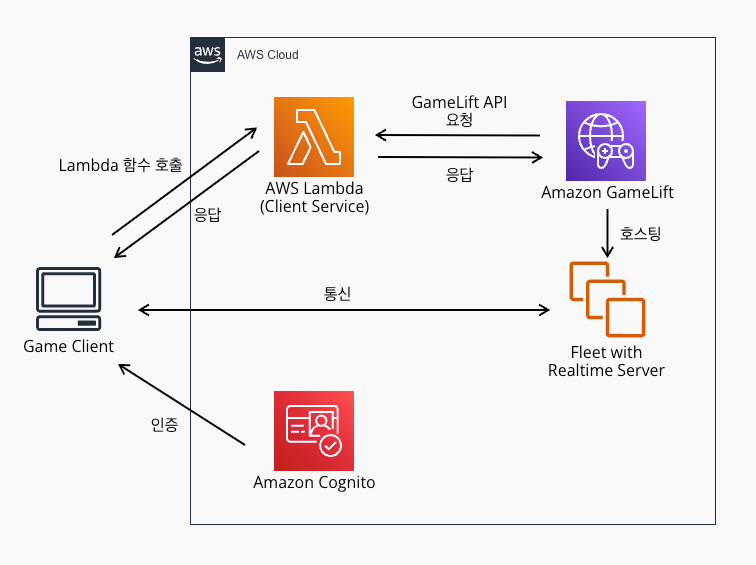

Beta이 글은 Amazon SageMaker를 사용하여 LLM 응답을 스트리밍 방식으로 서빙하는 방법을 설명합니다. 일반적으로 SageMaker 모델은 API Gateway와 Lambda를 통해 서빙되지만, API Gateway는 응답 스트리밍을 지원하지 않습니다.

js 기반의 Lambda Function을 사용하여 모델 응답을 토큰 단위로 스트리밍하는 방법을 제시합니다. 또한, CloudFront와 Lambda Function URL을 연동하여 sigV4 인증을 우회하고 효율적으로 모델 응답을 스트리밍하는 방안을 소개합니다.

이는 LLM과 같이 응답 생성에 시간이 오래 걸리는 모델의 사용자 경험을 개선하는 데 초점을 맞추고 있습니다. 을 개선하는 데 초점을 맞추고 있습니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기