효율적 시맨틱 검색을 위한 kubernetes GPU inference 시스템 구축하기

KubernetesGPUInferenceSemantic SearchAITriton Inference Server

AI 요약

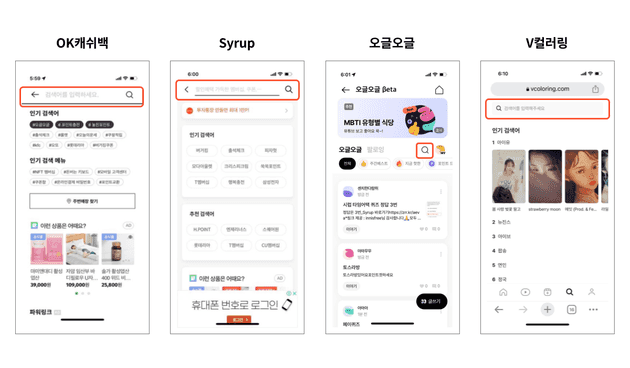

Beta이 글은 AI 기술 발전과 함께 중요성이 커지고 있는 시맨틱 검색을 에이닷 뉴스 검색 서비스에 적용한 경험을 공유합니다. 기존 키워드 기반 검색의 한계를 극복하고, 검색어와 관련 없는 뉴스나 여러 키워드가 함께 등장하여 관련성이 떨어지는 뉴스를 개선하기 위해 시맨틱 검색을 도입했습니다.

이를 위해 실시간 수준의 시맨틱 검색을 지원하고 대규모 데이터를 빠르게 처리할 수 있는 GPU 인프라 구축의 필요성을 강조합니다. 특히 NVIDIA의 Triton Inference Server를 활용하여 GPU 성능을 최적화하고, Kubernetes를 통해 컨테이너 기반 애플리케이션의 배포, 스케일링, 관리를 자동화하여 확장 가능하고 안정적인 운영 환경을 구축한 과정을 설명합니다.

이를 통해 효율적인 시맨틱 검색 시스템을 구축하는 방안을 제시합니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기