Auto ML Edge on Docker

AutoMLDocker엣지 컴퓨팅MLOpsDeployment

AI 요약

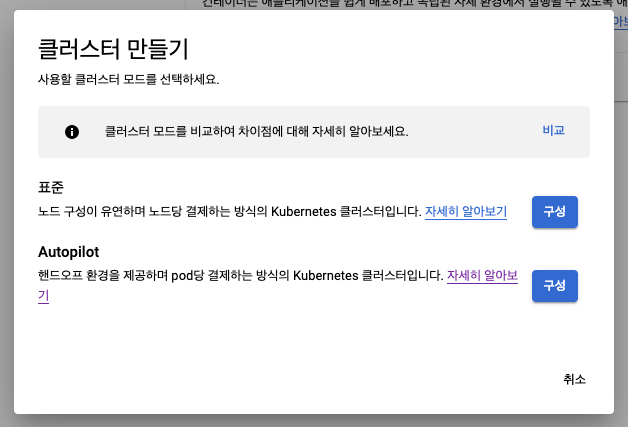

Beta이 글은 AutoML Edge를 Docker 환경에서 운영하는 방법에 대해 다룹니다. 기존의 사용량 기반 과금 방식에서 벗어나 직접 서버를 운영하거나 클라우드에서 자동 배포하는 방식으로 변화하는 추세를 설명하며, Docker를 활용하여 AutoML 모델을 엣지 디바이스에 효율적으로 배포하고 관리하는 과정을 소개합니다.

특히, 엣지 환경에서의 모델 서빙 및 관리에 대한 기술적인 고려사항과 Docker 컨테이너를 이용한 배포의 장점을 강조합니다. MLOps 관점에서 모델의 배포, 운영, 관리를 자동화하고 효율화하는 데 초점을 맞추고 있습니다.

이 글이 궁금하신가요?

원문 블로그에서 전체 내용을 확인해 보세요

원문 읽으러 가기